Как за 15 минут проверить ответ ИИ и превратить его в доказательную базу

11 декабря 2025

Искусственный интеллект стал частью работы юристов — от составления черновиков до поиска практики. Но вместе со скоростью появились и риски. Судебные системы уже фиксируют ошибки, допущенные из-за использования ИИ.

В 2025 году только за пять месяцев по всему миру выявлено более 70 процессуальных ситуаций, в которых в материалы дела попадали вымышленные «факты», сгенерированные моделью. Исследователь Дамьен Шарлотен ведет открытую базу, где около 120 актов содержат подобные искажения. Санкции становятся ощутимыми: в ряде дел штрафы превысили 10 000 $.

Отказываться от технологий невозможно: это ударит по скорости и конкурентоспособности. Значит, ключевой навык ближайших лет — эффективная проверка ответов ИИ. Вместе с юридическим консультантом Владимиром Кутаевым разберемся, как это делать быстро и надежно.

Ошибки ИИ стали частым явлением

Рост количества случаев объясним сразу несколькими факторами:

- Бизнес повсеместно внедряет ИИ, в том числе в подготовку документов и аналитику. Ответы моделей без проверки становятся потенциальным процессуальным риском.

- Модели не понимают основ права и не отслеживают изменения в законодательстве — они продолжают текст логически и не погружаются в смысл.

- Информационная база быстро устаревает: изменение одной нормы может обесценить массив ранее корректных решений.

В России тенденции схожие. Владимир Кутаев отметил, что все больше документов имеют характерные следы машинной генерации. Пока ошибки встречаются редко — только потому, что юристы тщательно все проверяют.

Из обсуждаемых случаев — решение суда в Краснодарском крае, язык которого заметно отличался от привычного стиля. Наблюдатели сделали вывод, что судья мог использовать ИИ при подготовке решения. Прямых доказательств нет, но сам факт дискуссии говорит: и суды, и практикующие юристы используют ИИ в работе.

В ближайшие пять лет таких кейсов станет больше.

Почему ИИ ошибается: три типа искажений

1. Галлюцинации: выдуманные факты и практика

ИИ уверенно сообщает о несуществующих:

- постановлениях КС РФ;

- делах Верховного суда;

- обзорах и статистике.

«Факты» выглядят убедительно, но не имеют отношения к реальности. Опора на них может приводить к ошибочным рекомендациям и вводить суд в заблуждение.

2. Устаревшие данные

ИИ приводит норму закона или практику, которая изменилась либо утратила силу. Причина в том, что многие модели, в том числе GPT, обучены на данных, которые актуальны лишь на определенную дату.

В результате ИИ формирует вывод, который выглядел бы корректным в 2021 году, но не применим в 2025-м.

3. Ложные ссылки

Нейросеть формирует внешне убедительные конструкции:

- номер дела, похожий на реальный;

- «Постановление № …» с логичным названием;

- цитату из статьи, которую невозможно найти в тексте закона.

Но при попытке проверки ссылка не открывается, а текст «цитаты» не совпадает с оригиналом.

Все эти ошибки объяснимы: модель не различает реальность и вымысел, не понимает логику норм и не следит за актуальностью. Поэтому любой ответ ИИ — черновик, а не готовая позиция.

Последствия искажений ИИ для юристов

В лучшем случае ошибки нейросети приведут к потере времени на проверку. В худшем — лягут в основу существенных профессиональных рисков.

1. Введение суда или коллег в заблуждение

Ссылка на несуществующее дело, статью закона или вымышленную цитату формирует у суда ложное представление о позиции стороны. Даже при отсутствии умысла юрист может оказаться в ситуации, когда его действия расцениваются как недобросовестные.

2. Возможные санкции и дисциплинарные меры

Если факт недостоверности вскроется, суд вправе применить штрафы, а внутри организации или профессионального сообщества могут быть дисциплинарные последствия.

3. Ослабление доверия к юристу

Даже единичная ошибка снижает доверие клиента, партнёров и суда к качеству работы. Исправление последствий занимает время, а репутационные издержки — самые длительные и трудно обратимые.

Как проверить ответ ИИ: 7 шагов

Представьте, что вы получили от нейросети развернутый ответ на юридический вопрос. Например, ИИ предложил аргументы для иска. Ниже — рабочий алгоритм проверки.

Шаг 1. Разбейте ответ ИИ на части

Выделите в ответе ИИ:

- факты и цифры;

- ссылки на статьи закона;

- номера дел и реквизиты актов;

- выдержки из обзоров, докладов, статистики;

- ключевые выводы.

Удобно завести короткий список: «Факт 1», «Факт 2», «Норма 1», «Дело 1» и так далее. Задача здесь: превратить один ответ в набор элементов, которые можно проверить.

Шаг 2. Проверьте каждый элемент в первоисточниках

Используйте проверенные источники: КАД Арбитр, ПравоДела, ПравоПрактика, сайты судов. Ответьте на три вопроса:

- Существуют ли указанные акты и дела?

- Совпадает ли содержание с тем, что «сказал» ИИ?

- Корректны ли цифры и статистика?

Шаг 3. Сверьте цитаты и ссылки

Проверьте:

- что источник существует;

- что цитата передана корректно, без искажений смысла;

- что содержание источника поддерживает вывод, для которого использовано.

Шаг 4. Оцените юридическую логику

Взгляните на текст как на черновик младшего юриста:

- корректны ли предпосылки;

- не пропущены ли важные условия задачи;

- действительно ли выводы следуют из приведенных норм и практики;

- нет ли внутренних противоречий.

ИИ часто правильно перечисляет нормы, но ошибается при применении их к ситуации.

Шаг 5. Проверьте актуальность норм и данных

Дальше — вопрос «на какую дату это все справедливо». Проверьте:

- действует ли указанная редакция закона;

- практику — не вышло ли новое разъяснение ВС или Пленума;

- не появились ли более свежие данные или отчеты.

Шаг 6. Уточните сомнительные моменты

Можно попытаться прояснить факт через дополнительный запрос. Например:

- «Укажи источник этого вывода»;

- «Как завершилось дело N?»;

- «Приведи альтернативную версию».

Если модель уклоняется от ответа или меняет версию — этот фрагмент использовать нельзя.

Лайфхак: подключать несколько нейросетей. Если они дают разные факты, лучше вернуться к самостоятельной проверке.

Шаг 7. Соберите свою проверенную доказательственную базу

После всех проверок у вас появляются:

- подтвержденные факты;

- реальные решения и нормы;

- достоверные цитаты;

- выводы, которые выдержали анализ.

На их основе можно переписать ответ ИИ в формат юридического заключения.

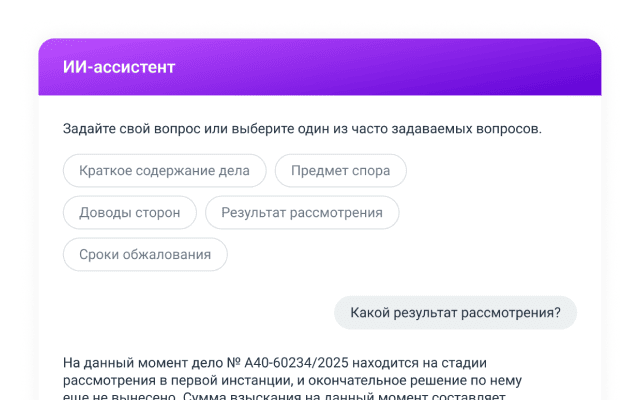

Как ИИ работает в профессиональных сервисах

Важно помнить, что ИИ подходит далеко не для всех задач.

Как правило, это всегда два типа: «что-то рутинное» и «что-то первичное». То есть ИИ неплохо может определить и указать риски для договора, так сказать, задать направление работы. Или же ИИ может хорошо переводить юридический документ на английский язык.

Главный риск в работе с ИИ напрямую в других сферах понятен: нейросеть может придумать норму, дело или статистику. Поэтому нужны постоянные проверки.

В готовых юридических сервисах, например в экосистеме ПравоТех, ИИ работает иначе. Он опирается на реальные судебные акты, официальные тексты НПА и уже может ускорить ряд задач.

Юрист по-прежнему отвечает за стратегию, оценку рисков и финальный текст документа. Просто теперь на это остается больше времени — потому что часть работы с массивами правовых данных берет на себя ИИ.

Искусственный интеллект — ускоритель, а не последняя инстанция

Суд смотрит не на то, что сказал алгоритм, а на то, что подписал человек. ИИ полезен как стажер: он может быстро просмотреть массив материалов, предложить варианты рисков, подготовить черновик.

Но ответственность за финальный текст, стратегию и корректность ссылок несет юрист.

С грамотным подходом ИИ превращается из источника рисков в инструмент, который экономит часы работы и повышает качество анализа — если опираться на первоисточники и проверенные данные.

Поделиться: